前言

最近openclaw风生水起,各大厂商推出了专属的“龙虾服务”。云主机服务商提供“龙虾”专用免费云主机;互联网大厂发布自家“龙虾”客户端并免费送token。但免费只是引流,随着用户使用习惯逐步养成后收费项目就会慢慢展开。比如云主机仅限免费30天,免费token额度越送越少。所以要随心所欲长期折腾AI,还得是本地自建一套大模型,一次性投入解决token焦虑。在此记录分享我最近从零开始本地搭建大模型过程及趟过的坑。

正文

显卡选择

第一次本地搭建大模型,所以目标比较低:

1. 使用openclaw能有不错的聊天体验(尝试过纯CPU跑模型,5分钟响应一个任务,没有任何客户体验) 2. 简单信息查询,资料整理

基于以上需求,我计划投入400RMB尝试本地搭建大模型。在海鲜市场逛了一圈后看中了Nvidia的Tesla系列M60显卡16G显存,300元左右(但在后面安装ollama就后悔了)

基础设置

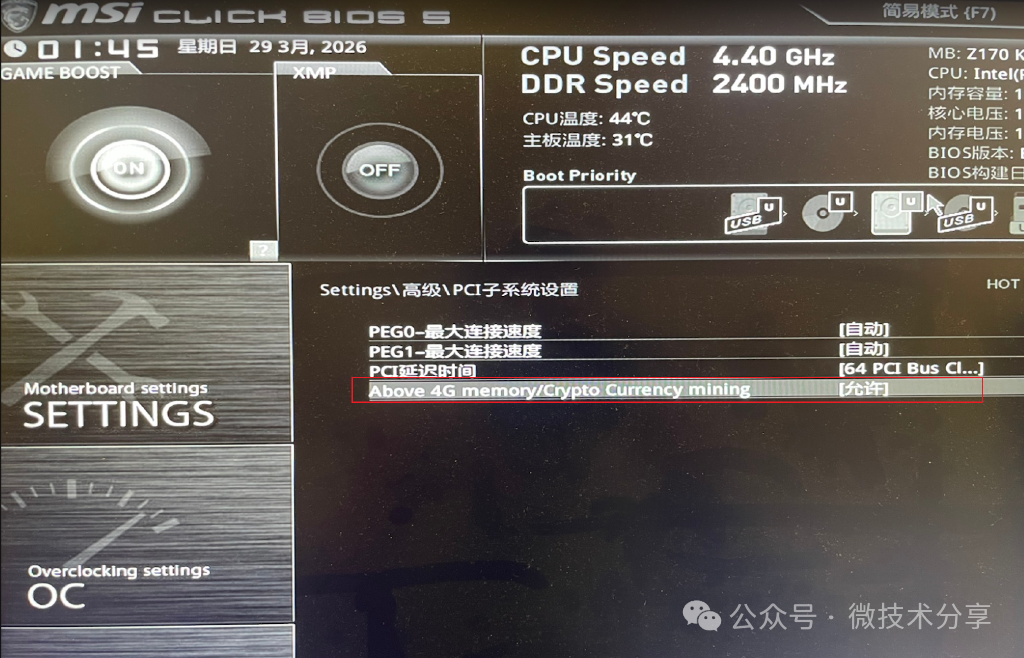

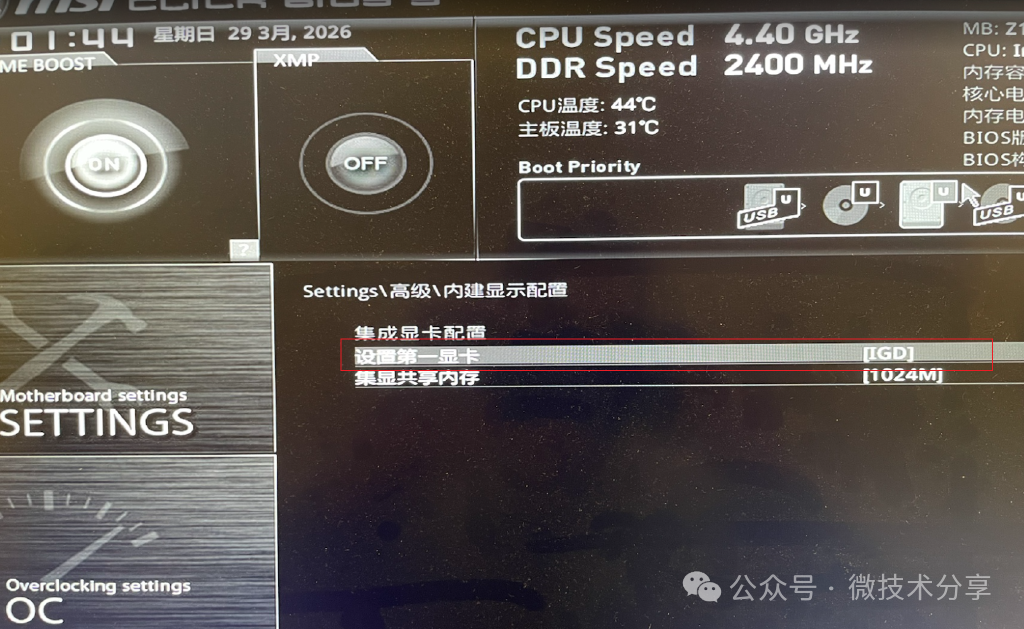

1. 主机电源500w以上 2. 主板Bios中有Abose 4G选项并开启。(我的微星Z170,bios里找了半天没找到,后面更新Bios固件后找到该选项) 3. 设置主板Bios,默认使用集显或亮机卡进操作系统(这坑上我趟了3天,如果没设置正常开机会黑屏或花屏) 4. tesla显卡专用8Pin电源线,与主机电源8Pin线不通用需单独购买转接线。

驱动及CUDA安装

基本都按网上教程一步步操作,需要注意驱动和CUDA版本不能随意装,有绑定关系。可以先安装驱动,然后通过命令nvidia-sim -L 查看驱动支持最高的CUDA版本,再去下载安装CUDA

显卡驱动(https://www.nvidia.cn/drivers)

安装CUDA(https://developer.nvidia.com/cuda-toolkit-archive)

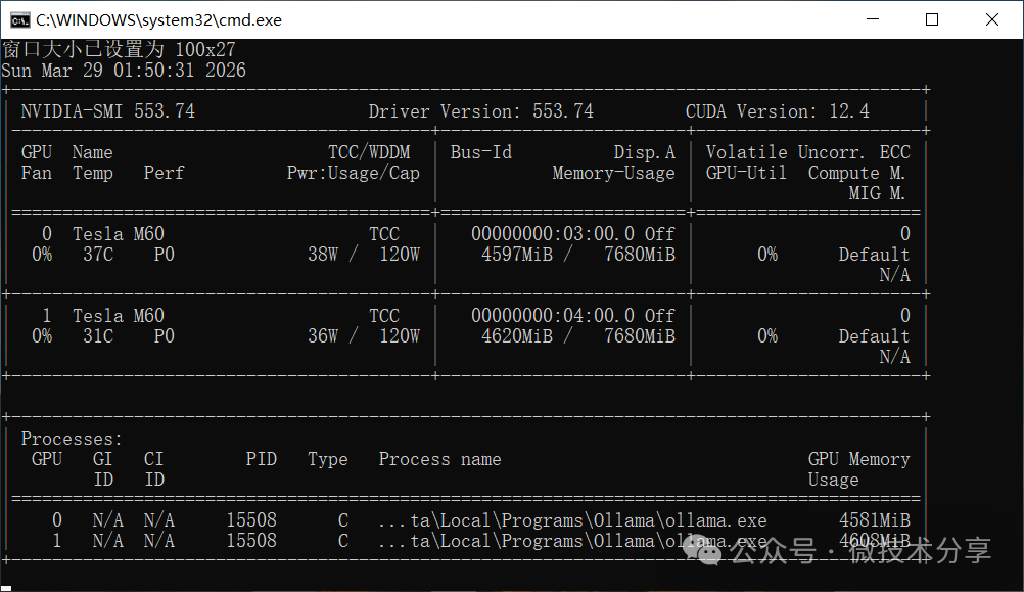

显卡调试

nvidia-smi -l 2

ollama安装配置

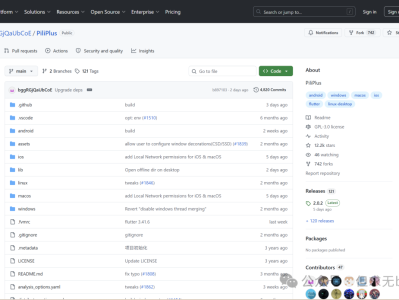

安装ollama在方法教程里面看到了这个表格,就知道显卡性能,再参考咸鱼价格就更好的选择。

9.0 8.9 8.6 8.0 7.5 7.0 6.1 6.0 5.2 5.0

ollama安装(https://ollama.com)

nvidia-smi -L # 展示可用显卡

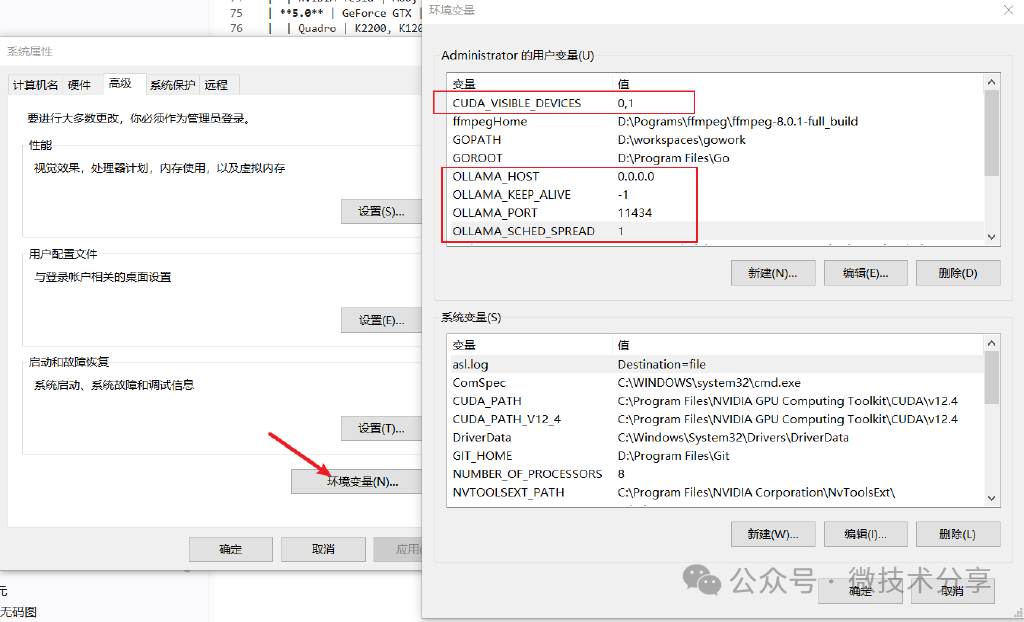

#修改ollama默认启动配置

CUDA_VISIBLE_DEVICES=0,1 #代表让ollama能识别到第几张显卡

OLLAMA_SCHED_SPREAD=1 #这几张卡均衡使用

OLLAMA_KEEP_ALIVE=-1 #模型一直加载, 不自动卸载

OLLAMA_HOST=0.0.0.0 #监听地址

OLLAMA_PORT=11434 #监听端口

openclaw本地配置

openclaw安装(https://docs.openclaw.ai/zh-CN/install)

总结

记录分享我从选择显卡、BIOS设置、驱动安装到ollama配置过程中的坑,有需要的可以参考。

参考

Tesla V100 在 Windows 下安装配置

Nvidia Tesla P100在WIN10下目前(2026年1月28号)能启用WDDM和CUDA的最新版

ollama部署deepseek, 多显卡负载均衡

保姆级教程 Ollama 部署 DeepSeek-R1 本地模型

本文链接:https://www.kinber.cn/post/6471.html 转载需授权!

推荐本站淘宝优惠价购买喜欢的宝贝:

支付宝微信扫一扫,打赏作者吧~

支付宝微信扫一扫,打赏作者吧~